아이템 강화 확률 (12강 -> 18강을 이루기 위한 평균 기대 횟수는?)

기본 개념 : 마르코프 체인, Markov chain, 마르코프 연쇄, 마코브 연쇄

아이템 강화 확률 (12강 -> 18강을 이루기 위한 평균 기대 횟수는?)

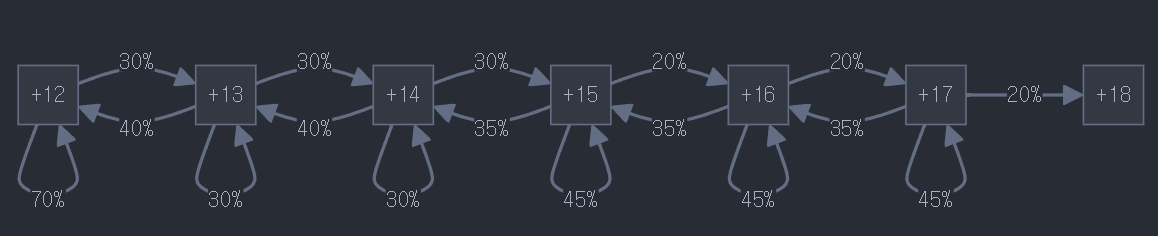

마르코프 연쇄 이론을 위의 아이템 강화 시나리오에 적용하기 위해, 각 용어를 정의해 보겠습니다.

1. 확률공간 (Probability Space)

확률공간은 마르코프 연쇄의 상태와 그 상태들 사이의 전이 확률로 정의됩니다.

- 상태공간 (State Space): 아이템의 강화 단계로 정의됩니다. 이 경우, 상태공간은 \(\{12, 13, 14, 15, 16, 17, 18\}\)입니다. 상태 18은 최종 상태이므로, 이후 단계는 없습니다.

- 전이확률행렬 (Transition Probability Matrix): 각 상태에서 다른 상태로 전이할 확률을 담고 있는 행렬입니다. 여기서, 전이확률행렬 \(P\)는 다음과 같습니다:

\[

P = \begin{bmatrix}

0.7 & 0.3 & 0 & 0 & 0 & 0 & 0 \\

0.4 & 0.3 & 0.3 & 0 & 0 & 0 & 0 \\

0 & 0.4 & 0.3 & 0.3 & 0 & 0 & 0 \\

0 & 0 & 0.35 & 0.45 & 0.2 & 0 & 0 \\

0 & 0 & 0 & 0.35 & 0.45 & 0.2 & 0 \\

0 & 0 & 0 & 0 & 0.35 & 0.45 & 0.2 \\

0 & 0 & 0 & 0 & 0 & 0 & 1

\end{bmatrix}

\]

여기서 \(P_{ij}\)는 상태 \(i\)에서 상태 \(j\)로 전이할 확률을 의미합니다.

2. 가측 공간 (Measurable Space)

마르코프 연쇄에서의 가측 공간은 주로 상태공간의 부분집합으로서, 우리가 관심 있는 사건들을 정의할 수 있는 집합입니다. 상태공간 자체가 가측 공간이 되며, 특정 강화 단계가 나타나는 사건들을 정의할 수 있습니다.

- 상태공간 \(\{12, 13, 14, 15, 16, 17, 18\}\) 자체가 가측 공간입니다.

3. 메모리 (Memory)

메모리는 마르코프 연쇄의 중요한 개념으로, 현재 상태만으로 미래 상태를 예측할 수 있는 성질을 의미합니다. 즉, 마르코프 연쇄는 현재 상태가 주어지면, 과거 상태는 기억할 필요가 없습니다.

- 여기서 메모리는 '마르코프 성질'을 의미합니다. 즉, 다음 단계의 상태는 오직 현재 상태에 의존하며, 이전의 상태들은 영향을 미치지 않습니다.

4. 확률 변수 (Random Variables)

확률 변수는 상태를 나타내는 변수로, 마르코프 연쇄에서는 각 시점의 상태를 확률 변수로 모델링합니다.

- 예를 들어, 강화 시도 후 아이템의 단계는 확률 변수 \(X_t\)로 나타낼 수 있습니다. 여기서 \(X_t\)는 강화 시도의 시점 \(t\)에서 아이템의 단계입니다. \(X_t\)는 상태공간 \(\{12, 13, 14, 15, 16, 17, 18\}\)의 값을 가집니다.

5. 시간 동질 마르코프 연쇄

주어진 아이템 강화 시나리오를 기반으로 한 마르코프 연쇄는 시간 동질 마르코프 연쇄 (Time-Homogeneous Markov Chain)입니다.

주어진 전이 확률 행렬을 보면, 각 상태에서 다른 상태로의 전이 확률은 상태의 시점에 관계없이 동일하게 유지됩니다. 즉, 상태 12에서 13으로 전이할 확률이 0.3이고, 13에서 14로 전이할 확률이 0.3입니다. 이러한 확률은 시간이 지남에 따라 변화하지 않으며, 일정합니다.

따라서 이 마르코프 연쇄는 시간 동질적입니다.

이러한 특성 덕분에 시간 동질 마르코프 연쇄는 분석이 용이하며, 장기적인 상태 분포, 평균 상태 도달 시간, 흡수 상태 등을 계산하는 데 유용합니다.

이러한 정의를 바탕으로 마르코프 연쇄 이론을 통해 아이템 강화의 동작을 모델링하고 분석할 수 있습니다.

마르코프 연쇄의 평균 흡수 시간(Mean Absorption Time) 이론은 마르코프 연쇄 이론에서 중요한 개념 중 하나입니다. 이를 이해하기 위해, 먼저 마르코프 연쇄와 흡수 상태(Absorbing State)에 대해 간략히 설명하겠습니다.

1. 마르코프 연쇄(Markov Chain)

마르코프 연쇄는 시스템이 시간에 따라 상태를 변화시키는 모델입니다. 각 상태는 현재 상태에만 의존하고, 이전의 상태에는 의존하지 않는다는 특징이 있습니다. 이러한 성질을 '마르코프 성질'이라고 합니다.

2. 흡수 상태(Absorbing State)

마르코프 연쇄의 상태 중에서 '흡수 상태'란, 한 번 그 상태에 도달하면 그 상태를 벗어날 수 없는 상태를 말합니다. 흡수 상태로 도달하면 시스템은 그 상태에 머무르게 됩니다. 모든 상태가 결국 흡수 상태로 전이되는 마르코프 연쇄를 '흡수 마르코프 연쇄'라고 합니다.

3. 평균 흡수 시간(Mean Absorption Time)

평균 흡수 시간은 어떤 상태에서 시작해서 흡수 상태에 도달할 때까지의 평균 시간을 의미합니다. 이는 주어진 상태에서 흡수 상태로 전이되는 데 걸리는 평균 단계 수를 계산하는 것입니다.

계산 방법

1. 전이 확률 행렬(Transition Probability Matrix): 마르코프 연쇄의 전이 확률 행렬을 \( P \)라고 할 때, 이 행렬은 상태들 간의 전이 확률을 나타냅니다.

2. 흡수 상태와 비흡수 상태 구분: 상태를 흡수 상태와 비흡수 상태로 나누어, 전이 확률 행렬을 블록 행렬로 분해합니다.

- \( P \) 행렬을 다음과 같이 나누어 표현할 수 있습니다:

\[

P = \begin{bmatrix}

Q & R \\

0 & I

\end{bmatrix}

\]

여기서, \( Q \)는 비흡수 상태 간의 전이 확률을 나타내고, \( R \)는 비흡수 상태에서 흡수 상태로 전이되는 확률을 나타냅니다. \( I \)는 단위 행렬로, 흡수 상태 간의 전이 확률을 나타냅니다.

3. 기대 흡수 시간 행렬 계산: 평균 흡수 시간 행렬 \( N \)는 비흡수 상태에서 흡수 상태에 도달하는 데 걸리는 평균 단계를 나타내는 행렬입니다. 이 행렬은 다음과 같이 계산됩니다:

\[

N = (I - Q)^{-1}

\]

여기서 \( (I - Q)^{-1} \)는 \( I - Q \)의 역행렬입니다.

- \( N_{ij} \)는 비흡수 상태 \( i \)에서 시작하여 흡수 상태에 도달할 때까지의 평균 단계 수를 나타냅니다.

예시

예를 들어, 두 개의 비흡수 상태와 두 개의 흡수 상태가 있는 마르코프 연쇄를 고려해 보겠습니다. 각 상태에서 흡수 상태로 전이되는 확률과 비흡수 상태 간의 전이 확률이 주어지면, 위의 방법을 통해 평균 흡수 시간을 계산할 수 있습니다.

이론적으로, 평균 흡수 시간은 시스템의 동작을 이해하고, 특정 상태에서의 장기적인 행동을 분석하는 데 유용한 도구입니다.

댓글3

-

세상의모든계산기

파이썬 프로그램을 통한 검증

Claude 3.5 Sonnet

import numpy as np def calculate_expected_attempts(): # 전이 행렬 정의 (12강부터 18강까지, 18강은 흡수 상태) P = np.array([ [0.7, 0.3, 0, 0, 0, 0, 0], [0.4, 0.3, 0.3, 0, 0, 0, 0], [0, 0.4, 0.3, 0.3, 0, 0, 0], [0, 0, 0.35, 0.45, 0.2, 0, 0], [0, 0, 0, 0.35, 0.45, 0.2, 0], [0, 0, 0, 0, 0.35, 0.45, 0.2], [0, 0, 0, 0, 0, 0, 1] # 18강은 흡수 상태 ]) # 기본 상태 (12강)에서 시작 initial_state = np.array([1, 0, 0, 0, 0, 0, 0]) # 흡수 상태에 도달할 때까지의 평균 단계 수 계산 N = np.linalg.inv(np.eye(6) - P[:6, :6]) expected_steps = N.sum(axis=1) return expected_steps[0] # 시뮬레이션 실행 expected_attempts = calculate_expected_attempts() print(f"18강에 도달하기 위한 평균 기대 시도 횟수: {expected_attempts:.2f}") # Monte Carlo 시뮬레이션을 통한 검증 def simulate_enhancement(num_simulations=100000): total_attempts = 0 for _ in range(num_simulations): attempts = 0 current_level = 12 while current_level < 18: attempts += 1 rand = np.random.random() if current_level == 12: if rand < 0.7: continue else: current_level = 13 elif current_level <= 14: if rand < 0.4: current_level -= 1 elif rand < 0.7: continue else: current_level += 1 else: if rand < 0.35: current_level -= 1 elif rand < 0.8: continue else: current_level += 1 total_attempts += attempts return total_attempts / num_simulations simulated_attempts = simulate_enhancement() print(f"몬테카를로 시뮬레이션 결과 (평균 시도 횟수): {simulated_attempts:.2f}")18강에 도달하기 위한 평균 기대 시도 횟수: 212.02

몬테카를로 시뮬레이션 결과 (평균 시도 횟수): 212.17 -

세상의모든계산기

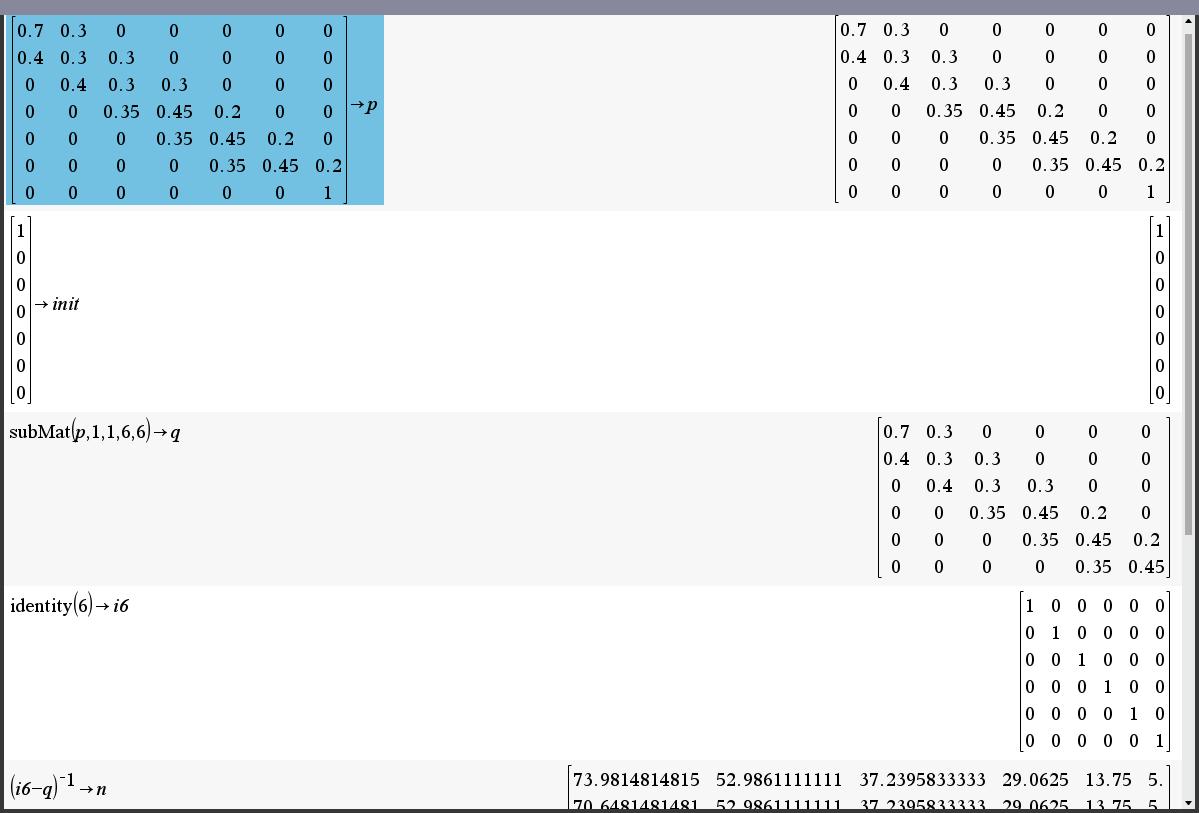

위 과정을 행렬(matrix)로 나타내면, Markov 과정의 전이 행렬을 포함하여 상태 전이 행렬, 그리고 평균 도달 단계 수를 계산하는 방법을 설명할 수 있습니다.

구체적으로, 이 문제는 마르코프 체인의 흡수 상태에 도달하기까지의 평균 단계 수를 계산하는 것을 포함합니다. 이를 위해 필요한 주요 단계와 관련된 행렬은 다음과 같습니다:

1. 전이 행렬 (Transition Matrix)

전이 행렬 \( P \)는 상태 간 전이 확률을 나타냅니다. 문제에서 주어진 전이 행렬은 다음과 같습니다:

\[

P = \begin{bmatrix}

0.7 & 0.3 & 0 & 0 & 0 & 0 & 0 \\

0.4 & 0.3 & 0.3 & 0 & 0 & 0 & 0 \\

0 & 0.4 & 0.3 & 0.3 & 0 & 0 & 0 \\

0 & 0 & 0.35 & 0.45 & 0.2 & 0 & 0 \\

0 & 0 & 0 & 0.35 & 0.45 & 0.2 & 0 \\

0 & 0 & 0 & 0 & 0.35 & 0.45 & 0.2 \\

0 & 0 & 0 & 0 & 0 & 0 & 1 \\

\end{bmatrix}

\]2. 기본 상태 (Initial State Vector)

초기 상태는 12강 상태에서 시작하므로 초기 상태 벡터는:

\[

\text{initial\_state} = \begin{bmatrix}

1 & 0 & 0 & 0 & 0 & 0 & 0

\end{bmatrix}

\]3. 정방 행렬 (Fundamental Matrix) 계산

흡수 상태를 제외한 전이 행렬의 하위 행렬 \( Q \)를 사용하여 정방 행렬 \( N \)을 계산합니다. 여기서 하위 행렬 \( Q \)는 전이 행렬의 흡수 상태를 제외한 부분입니다:

\[ Q = \begin{bmatrix}

0.7 & 0.3 & 0 & 0 & 0 & 0 \\

0.4 & 0.3 & 0.3 & 0 & 0 & 0 \\

0 & 0.4 & 0.3 & 0.3 & 0 & 0 \\

0 & 0 & 0.35 & 0.45 & 0.2 & 0 \\

0 & 0 & 0 & 0.35 & 0.45 & 0.2 \\

0 & 0 & 0 & 0 & 0.35 & 0.45 \\

\end{bmatrix} \]정방 행렬 \( N \)은 다음과 같이 계산됩니다:

$ N = (I - Q)^{-1} $

\[

N = \begin{bmatrix}

73.981481481481 & 52.986111111111 & 37.239583333333 & 29.062499999999 & 13.750000000000 & 5.000000000000 \\

70.648148148148 & 52.986111111111 & 37.239583333333 & 29.062500000000 & 13.750000000000 & 5.000000000000 \\

66.203703703704 & 49.652777777778 & 37.239583333333 & 29.062500000000 & 13.750000000000 & 5.000000000000 \\

60.277777777778 & 45.208333333333 & 33.906250000000 & 29.062500000000 & 13.750000000000 & 5.000000000000 \\

49.907407407407 & 37.430555555556 & 28.072916666667 & 24.062500000000 & 13.750000000000 & 5.000000000000 \\

31.759259259259 & 23.819444444444 & 17.864583333333 & 15.312500000000 & 8.750000000000 & 5.000000000000 \\

\end{bmatrix}

\]여기서 \( I \)는 단위 행렬입니다.

\[

I = \begin{bmatrix}

1 & 0 & 0 & 0 & 0 & 0 \\

0 & 1 & 0 & 0 & 0 & 0 \\

0 & 0 & 1 & 0 & 0 & 0 \\

0 & 0 & 0 & 1 & 0 & 0 \\

0 & 0 & 0 & 0 & 1 & 0 \\

0 & 0 & 0 & 0 & 0 & 1 \\

\end{bmatrix}

\]

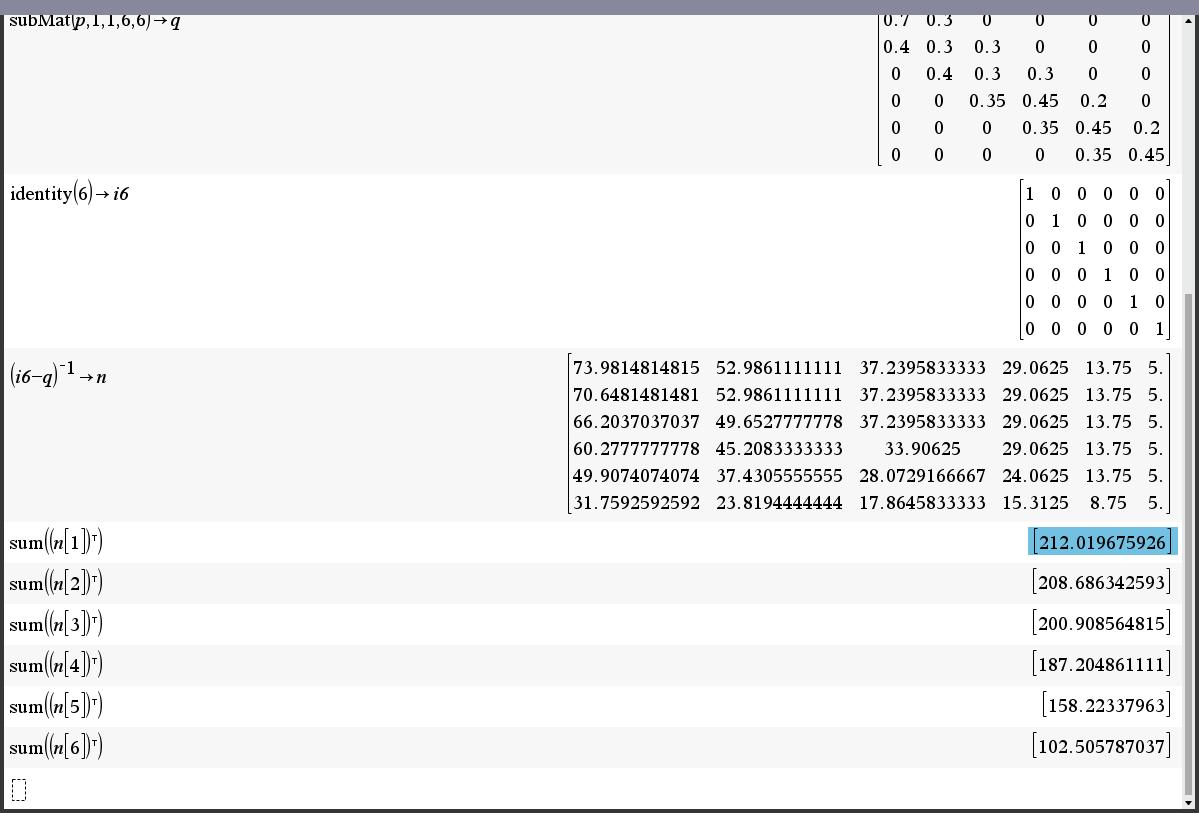

4. 평균 도달 단계 수

평균 도달 단계 수는 정방 행렬 \( N \)의 각 행의 합으로 계산됩니다.

첫 번째 행의 합 (12→18 평균 기대 강화 횟수) ≒ 212.02

\[

73.981 + 52.986 + 37.24 + 29.063 + 13.75 + 5 ≒ 212.02

\]두 번째 행의 합 (13→18 평균 기대 강화 횟수) ≒ 208.69

세 번째 행의 합 (14→18 평균 기대 강화 횟수) ≒ 200.91

네 번째 행의 합 (15→18 평균 기대 강화 횟수) ≒ 187.2

다섯 번째 행의 합 (16→18 평균 기대 강화 횟수) ≒ 158.22

여섯 번째 행의 합 (17→18 평균 기대 강화 횟수) ≒ 102.51

-

1

세상의모든계산기 님의 최근 댓글

감사합니다. 주말 잘 보내세요. 2026 03.06 [fx-570 ES] 과학 상수를 이용한 계산에서 에러 발생 상황 https://kin.naver.com/qna/detail.naver?d1id=11&dirId=1118&docId=492235162&page=1&answerNo=1 vs 2026 03.01 과학상수를 이용한 계산 중 자릿수 한계로 인한 에러 발생 가능성 https://allcalc.org:443/board_calculators/6925#comment_57029 2026 03.01 기본 어댑터 MODEL : AD0301-1202500GB INPUT : 100~240V, 50~60Hz, 0.8A Max OUTPUT : 12.0V, 2.5A, 30.0W ㄴ 측정시 플러그 외경/내경 : 5.5mm / 2mm 2026 02.15 엑셀 파일로 만드니 전체 160~200MB 정도 나옵니다. 읽고 / 저장하는데 한참 걸리네요. 컴 사양을 좀 탈 것 같습니다. -> 엑셀/한셀에서 읽히지만, 구글 스프레드시트에서는 열리지 않네요. 100만 개 단위로 끊어서 20MB 정도로 분할해 저장하는 편이 오히려 속 편할 것 같습니다. -> 이건 구글 스프레드시트에서도 열리긴 하네요. (약간 버퍼링?이 있습니다) 2026 02.10