- 세상의 모든 계산기 자유(질문) 게시판 일반 ()

알파고 2.0 ??

1. 경향신문 기사 中

작년 3월 이세돌 대국 당시 알파고는 구글이 개발한 AI용 칩인 ‘TPU’ 50개를 동원하는 등 대규모 전산 설비를 썼지만, 올해에는 TPU 4개를 얹은 산업용 컴퓨터(machine) 1대만 썼다.

원문보기:

http://news.khan.co.kr/kh_news/khan_art_view.html?artid=201705251847001&code=970204&nv=stand&utm_source=naver&utm_medium=newsstand&utm_campaign=row1_4#csidx014b2a168e8fece83d99057dbfba69d

2. 블로터 기사 中

이세돌 9단과 대국한 알파고는 구글 클라우드 상 50개의 TPU(Tensor Processing Unit)를 사용했다. TPU는 구글이 머신러닝을 위해 특별히 제작한 처리장치다. 1초에 50개의 수와 10만개의 형태를 탐색할 수 있었다. 현재 커제 9단과 대국 중인 알파고는 ‘알파고 마스터’라고 불리는 버전이다. 이번 구글 I/O 에서 공개된 단일 TPU 머신을 사용하며 2016년 버전 대비 10분의 1의 컴퓨팅 파워를 사용하면서도 더 빨리 계산한다.

http://www.bloter.net/archives/280664

3. NEXTPLATFORM - TPU2에 대한 기사 中

Google’s first generation TPU consumed 40 watts at load while performing 16-bit integer matrix multiplies at a rate of 23 TOPS. Google doubled that operational speed to 45 TFLOPS for TPU2 while increasing the computational complexity by upgrading to 16-bit floating point operations. A rough rule of thumb says that is at least two doublings of power consumption – TPU2 must consume at least 160 watts if it does nothing else other than double the speed and move to FP16. The heat sink size hints at much higher power consumption, somewhere above 200 watts.

https://www.nextplatform.com/2017/05/22/hood-googles-tpu2-machine-learning-clusters/

댓글13

-

세상의모든계산기

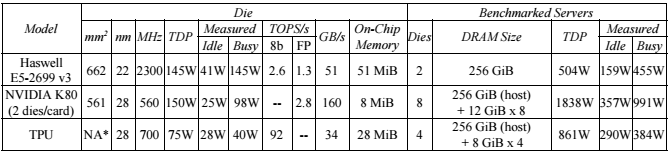

In-Datacenter Performance Analysis of a Tensor Processing Unit ™

https://drive.google.com/file/d/0Bx4hafXDDq2EMzRNcy1vSUxtcEk/view

※ 이 논문은 TPU2 가 아닌 TPU(1세대) 을 대상으로 작성된 논문입니다.

-

세상의모든계산기

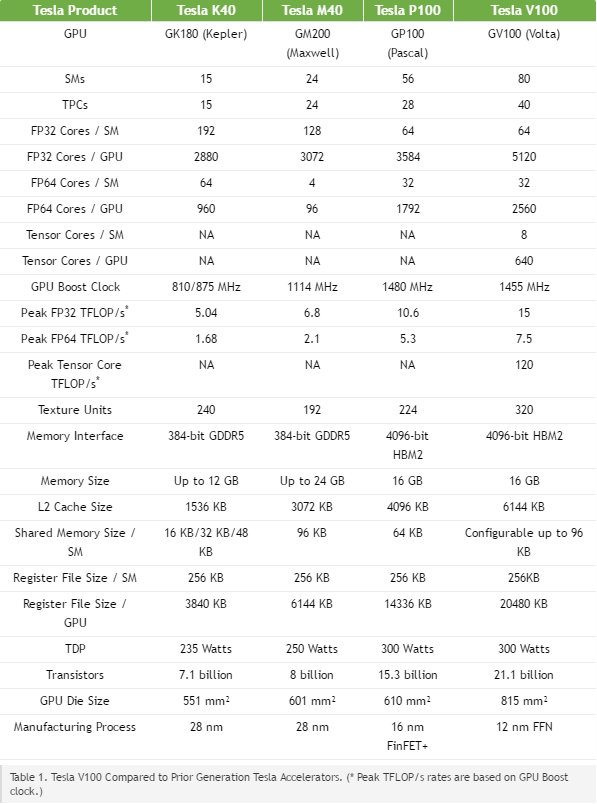

NVIDIA V100

출처 : https://devblogs.nvidia.com/parallelforall/inside-volta/?ncid=so-fac-vt-13920

Tesla V100 delivers industry-leading floating-point and integer performance. Peak computation rates (based on GPU Boost clock rate) are:

7.5 TFLOP/s of double precision floating-point (FP64) performance;

15 TFLOP/s of single precision (FP32) performance;

120 Tensor TFLOP/s of mixed-precision matrix-multiply-and-accumulate.

-

세상의모든계산기

팩트 정리를 해 보면...

1. 돌파고의 TPU는 TPU1 으로 불림2. 커파고의 TPU는 TPU2 로 불림

(칩을 TPU2 Chip 으로 부르기도 하는 듯)3. TPU2 모듈 1개는 TPU2코어 4개로 구성

4. TPU2 모듈의 성능 = 45테라플롭스/개*4개 = 180테라플롭스 (

5. https://www.tensorflow.org/tfrc/ 구글 텐서 크라우드?는 100개의 TPU2 모듈로 구성

각각의 TPU2 칩은 두개의 BlueLink 25GB/s 케이블로 연결 -

세상의모든계산기

추정

CPU 종류와 그 비율

출처 : https://www.nextplatform.com/2017/05/22/hood-googles-tpu2-machine-learning-clusters/

We believe that Google connected each CPU board to exactly one TPU2 board using both OPA cables to achieve 25 GB/s aggregate bandwidth. This one-to-one connectivity answers a key question for TPU2 – Google designed the TPU2 stamp with a 2:1 ratio of TPU2 chips to Xeon sockets. That is, four TPU2 chips for every dual-socket Xeon server.> 클라우드가 아닌 싱글머쉰에서 알파고가 돌아갔다면 제온 2소켓 보드 + TPU2 모듈*1개 구성이 맞는 듯

> CPU는 구글 문서에 나온대로 INTEL XEON E5-2699v3 인것 같음. 실질적 계산 역할은 그리 크지 않은 듯.

(seldom 하게 2.3GHz 이외 클럭으로 동작)> 전력소모는 구글 문서에 나온대로 TDP 861W, IDLE 290W, BUSY 384W (싱글머쉰 기준) 이 맞는 듯

세상의모든계산기 님의 최근 댓글

일반 계산기는 일반적으로 세팅이나 리셋기능이 따로 없기 때문에, 다른 요인에 영향을 받을 가능성은 없어 보이구요. '원래는 잘 되었는데, 지금은 설정 값이 날아간다'면 메모리 값을 유지할만큼 배터리가 꾸준하게 공급되지 않기 때문일 가능성이 높다고 봐야겠습니다. - 태양광이 있을 때는 계산은 가능하지만, 서랍등에 넣으면 배터리가 없어서 리셋 https://blog.naver.com/potatoyamyam/223053309120 (교체 사진 참조) 1. 배터리 준비: * 다이소 등에서 LR54 (LR1130) 배터리를 구매합니다. (보통 4개 들이 1,000원에 판매됩니다. LR44와 높이가 다르니 혼동하시면 안됩니다.) 2. 준비물: * 작은 십자드라이버 (계산기 뒷면 나사용. 이것도 없으시면 다이소에서...) 3. 커버 분해: * 계산기 뒷면의 나사를 풀고, 머리 부분(윗부분)의 커버를 조심스럽게 분해합니다. (참고해주신 블로그 사진을 보시면 이해가 빠르실 겁니다.) 4. 배터리 교체: * 기존 배터리를 빼냅니다. * 새 LR54 배터리의 '+'극 방향을 정확히 확인하여 제자리에 넣어줍니다. (대부분의 경우 '+'극이 위로 보이도록 넣습니다.) 5. 조립: * 커버를 다시 닫고 나사를 조여줍니다. * 블로그 사진을 보니 배터리 연결선 등이 눌려서 씹혀 있네요. 원래 씹히도록 설계를 안하는데, 원래 그렇게 만들어 놓은 건지? 모르겠네요. 여튼 씹히면 단선될 가능성이 있으니, 잘 보시고 플라스틱 틈새 등으로 적절히 배치해서 안씹히게 하는 것이 좋습니다. 6. TAX 재설정: * 계산기의 전원을 켜고 TAX 요율을 10%로 다시 설정합니다. 2025 12.10 TI-nspire 입력 방법 solve({x+a+b=5,x)|a=1 and b=2 2025 12.01 질문하실 때는 항상 계산기 모델명을 정확하게 적으셔야 합니다. 2025 12.01 참고 - [공학용 계산기] 로그의 입력 (log, ln) (feat. 밑 입력이 안되는 계산기는?) https://allcalc.org/14995 2025 11.14 HP-39gII 에 ExistOS 설치하기 https://allcalc.org/38526 2025 11.07